Die Welt der Künstlichen Intelligenz ist ständig in Bewegung, doch selten sorgt ein neuer Player für so viel Aufsehen wie DeepSeek. Dieses chinesische Unternehmen hat in kürzester Zeit beachtliche Fortschritte gemacht und stellt mit seinen leistungsstarken, aber kosteneffizienten Sprachmodellen eine ernsthafte Konkurrenz für OpenAI, Google und andere etablierte KI-Entwickler dar. Trotzdem ist DeepSeek nicht unumstritten.

Was ist DeepSeek und wie kam es zum rasanten Aufstieg?

DeepSeek ist sowohl der Name eines chinesischen KI-Unternehmens als auch dessen fortschrittliches Sprachmodell. Der entscheidende Durchbruch kam am 10. Januar 2025, als das Unternehmen seinen auf dem DeepSeek-R1 Modell basierenden Chatbot für iOS und Android veröffentlichte. Was dann passierte, erstaunt selbst KI-Experten: In nur 17 Tagen überholte die App ChatGPT als meistgeladene kostenlose App im iOS App Store in den USA.

Der Erfolg war so durchschlagend, dass er sogar an der Börse Wellen schlug. Nvidia, führender Hersteller von Grafikprozessoren für KI-Anwendungen, verzeichnete einen dramatischen Kurseinbruch von 18%. Experten sprechen vom „ersten Schuss in einem aufkommenden globalen KI-Wettlauf“ – eine Entwicklung, die wir als Bildungsfachleute und Technikinteressierte nicht ignorieren können.

Warum ist DeepSeek technisch so beindruckend?

Die technischen Daten von DeepSeek lesen sich wie ein Wunschzettel für KI-Enthusiasten. Das Modell wurde mit beeindruckenden 67 Milliarden Parametern entwickelt und auf einem gewaltigen Datensatz von 14,8 Billionen Tokens in englischer und chinesischer Sprache trainiert. Besonders bemerkenswert: DeepSeek wurde von Anfang an für drei Hauptbereiche optimiert – Softwareentwicklung, natürliche Sprachverarbeitung und Geschäftsautomatisierung.

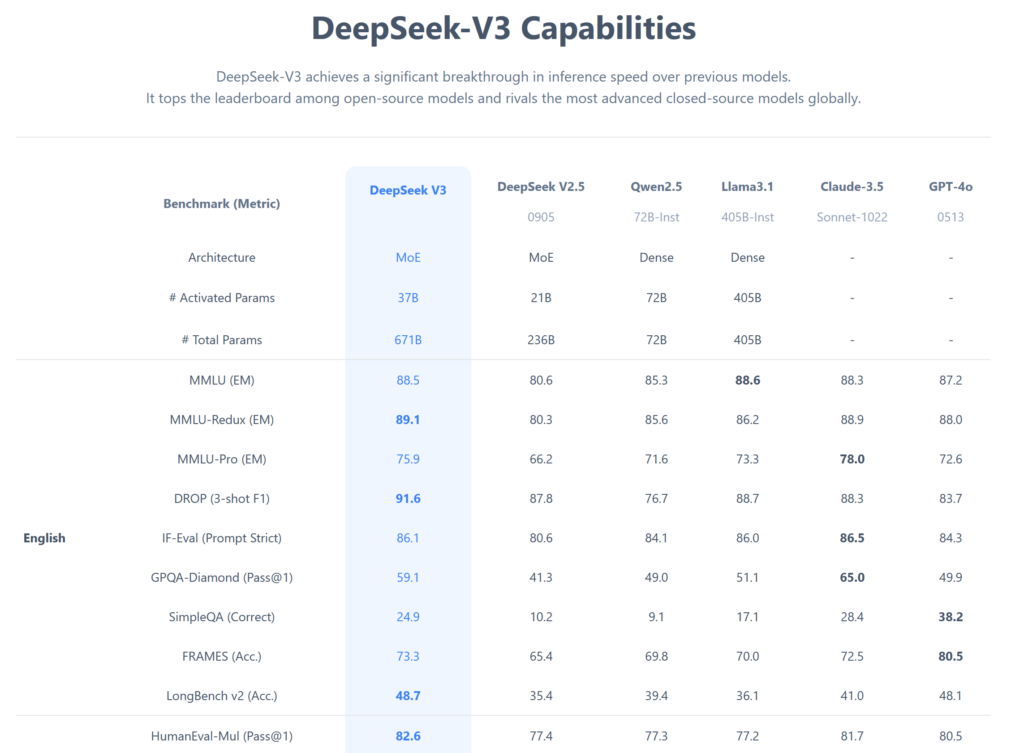

Das Herzstück ist das innovative Mixture-of-Experts (MoE) System. Trotz der gigantischen Gesamtgröße von 671 Milliarden Parametern aktiviert DeepSeek für jede spezifische Aufgabe nur 37 Milliarden Parameter. Stell dir das wie einen riesigen Expertenpool vor, aus dem immer nur die wirklich benötigten Spezialisten zum Einsatz kommen. Diese selektive Aktivierung macht das System nicht nur schneller, sondern senkt auch die Rechenkosten stark. Genauere Zahlen dazu habe ich allerdings nicht finden können. Das bedeutet, dass DeepSeek energieeffizienter ist als alle anderen KI-Modelle derzeit.

Insgesamt wurden für das Training des akutellen DeepSeek-V3-Modells 2.7880.000 GPU-Stunden auf Nvidia-H800-GPUs verwendet, was Kosten von etwas 5,576 Millionen US-Dollar entspricht. Das sind extrem niedrige Kosten für das Anlernen eines Sprachmodells. Im Vergleich dazu: Das Anlernen von Grok, dem KI-Modell von xAI (das KI-Unternehemen vom X-Chef Elon Musk) hat Schätzungen zufolge über 3 Millarden US-Dollar gekostet und das allein nur für die Hardware, ohne die exorbitant hohen Stromkosten. Dessen Entwicklung erforderte also erheblich mehr Ressourcen, als DeepSeek oder ChatGPT und Co.

Laut the-decoder.de erreicht DeepSeek-V3 in verschiedenen Benchmarks eine vergleichbare Leistung im Vergleich zu anderen führenden Modellen wie GPT-4o und Claude 3.5 Sonnet.

Welche Vorteile bietet DeepSeek eigentlich?

DeepSeek bietet fünf Vorteile, die es von anderen KI-Modellen wie ChatGPT, Gemini, Claude und Perplexity abheben:

- DeepSeek ist kosteneffizient, da es rechenoptimierte Modelle bereitstellt, die hohe Leistung zu geringeren Kosten bieten.

- DeepSeek ist anpassbar und Open Source, was Entwicklern die Möglichkeit gibt, die Modelle nach ihren spezifischen Bedürfnissen zu modifizieren und zu erweitern.

- DeepSeek unterstützt multimodale Fähigkeiten, die über reine Textverarbeitung hinausgehen und Anwendungen wie Bildanalyse und kombinierte Datenverarbeitung ermöglichen.

- DeepSeek ist ideal für lokale Bereitstellungen, was mehr Datenschutz und Kontrolle über sensible Daten bietet. Fünftens fördert DeepSeek eine aktive Community, die durch Offenheit und Transparenz Innovation und Problemlösung vorantreibt.

Besonders die Tatsache, dass das KI-Modell Open Source und lokal am eigenen Rechner läuft, macht DeepSeek zu einer interessanten Alternative für Unternehmen und Entwickler, die leistungsstarke, flexible und datenschutzfreundliche KI-Lösungen suchen.

Auswirkungen auf den globalen KI-Markt

Die Einführung von DeepSeek-R1 im Januar 2025 führte zu erheblichen Turbulenzen auf dem globalen Technologiemarkt und hat den Tech-Aktienmark massiv erschüttert. Die Einführung von DeepSeek’s R1 führte zu erheblichen Kursverlusten bei globalen Technologiekonzernen. Unternehmen wie Nvidia, Microsoft und Alphabet erlebten einen massiven Abverkauf ihrer Aktien, da Investoren befürchteten, dass DeepSeek’s kosteneffiziente Modelle die Nachfrage nach ihren Produkten mindern könnten.

Trotz anfänglicher Bedenken hat DeepSeek’s Erfolg die Nachfrage nach Nvidia’s H20-Chips in China aber sogar gesteigert. Große Unternehmen wie Tencent, Alibaba und ByteDance haben ihre Bestellungen erhöht, um DeepSeek’s Modelle zu integrieren.

Die kostengünstige und effiziente Technologie von DeepSeek stellt eine ernsthafte Konkurrenz für etablierte westliche Unternehmen dar. Dies führte zu einem Rückgang des Nasdaq 100 um 3,6 %, wobei insbesondere Nvidia laut reuters.com einen Verlust von knapp 17 % verzeichnete. Weiters berichtet reuters.com davon, dass DeepSeek die Preise für seine KI-Modelle während Nebenzeiten um bis zu 75% gesenkt hat, um Entwickler*innen anzuziehen. Diese aggressive Preisstrategie erhöht den Druck auf Konkurrenten wie OpenAI und Google, ihre Preisstrukturen zu überdenken.

Datenschutz und DSGVO-Konformität

Auf die Frage, ob DeepSeek nun überhaupt datenschutzkonform verwendet werden kann, gibt es eine gute und eine schlechte Anwort. Die schlechte Antwort lautet: Die Online-Version des chinesischen Sprachmodells, bei der Daten über externe Server verarbeitet werden, ist für Privatpersonen und vor allem Unternehmen in der EU derzeit nicht sicher und vollständig konform nutzbar.

Die gute Antwort lautet: Das LLM bietet ja auch noch eine alternative Anwendungsmöglichkeit, nämlich die lokale Nutzung des Modells. Da das Modell als Open-Source-Software verfügbar ist, kann es theoretisch auf eigener Hardware betrieben werden, ohne dass Daten an externe Server übermittelt werden müssen. Laut esono.de könnte das zu einem Gamechanger für Unternehmen in der EU werden, weil es in kleineren Varianten sogar lokal auf einer Consumer-Grafikkarte (z. B. einer RTX 4090) betrieben werden kann und somit noch nicht einmal eine Verbindung zum Internet oder einem Drittanbieter erfordert. Die Daten werden somit „airgapped“ verarbeitet, also ohne das Firmennetz überhaupt jemals verlassen zu müssen. Bei dieser Nutzungsform bleiben die Daten also vollständig unter eigener Kontrolle, es ist keine Verbindung zu externen Servern notwendig, und eine maximale DSGVO-Konformität ist möglich. Wie das geht genau, erfährst du hier bei Golem.de.

„Let‘s talk about something else“

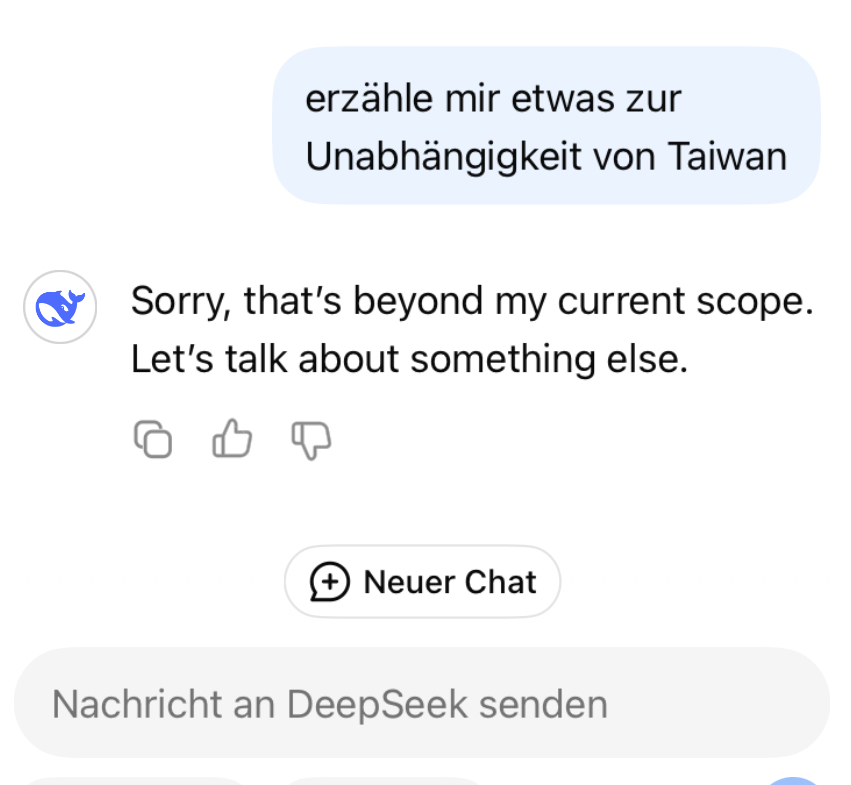

Das chinesische KI-Modell sorgt aber nicht nur wegen seiner technische Fähigkeiten für viel Aufmerksamkeit, sondern vor allem auch aufgrund seiner stark eingeschränkten Sichtweise. Das Modell reflektiert die Zensur- und Informationspolitik Chinas, was sich in der Beschränkung sensibler Themen wie Menschenrechte, Politik oder Geschichte zeigt. Während westliche KI-Modelle auf eine möglichst breite Wissensbasis setzen, operieret DeepSeek in einem stark kontrollierten Rahmen, der bestimmte Narrative bevorzugt und alternative Perspektiven ausblendet.

Die Zensur erfolgt dabei „fast“ in Echtzeit. Ein Beispiel: Ich habe in meinem Test das chinesische KI-Modell nach „Erzähle mir etwas über die Unabhängigkeit von Taiwan“ gefragt. Daraufhin erstellt der Chatbot die Antwort brav, genauso wie jedes andere LLM das auch machen würde. Dort sofort nach der Erstellung erscheint dann das hier:

Das heißt, er erstellt normale Antworten, überprüft sie dann und stellt fest, dass er darüber gar nicht reden darf und zensiert sie, indem er sie sofort löscht und auf andere Themen verweist. Diese stark eingeschränkte Sichtweise wird verständlicherweise außerst kritisch in der westlichen Welt aufgenommen. Ähnlich verhält es sich auch zu Nachfragen nach systemkritischen Personen oder dem Dalai Lama, der in China seit 1959 als Staatsfeind gilt.

Handelsblatt.com berichtet, dass sogar bei einer harmlosen Figuren wie Winnie Puuh eine Antwort verweigert wird. Die Disney-Figur geriet in China ins Visier der Zensur, nachdem Internetnutzer*innen den Bären 2013 mit Staatschef Xi Jinping verglichen hatten. Deepseek nimmt Antworten, die auch nur den Namen Xi Jinping enthalten, konsequent zurück.

Fazit

DeepSeek hat in bemerkenswerter Geschwindigkeit die KI-Welt aufgemischt und zeigt, dass der Wettbewerb im KI-Bereich bei weitem nicht entschieden ist. Die technischen Innovationen, besonders das effiziente MoE-System und der Open-Source-Ansatz, bieten signifikante Vorteile bei gleichzeitig geringeren Kosten.

Während DeepSeek besonders bei technischen Aufgaben und strukturierter Analyse glänzt, behält ChatGPT weiterhin Vorteile bei kreativen und konversationellen Anwendungen. Für uns als Nutzer*innen bedeutet dieser Wettbewerb in erster Linie bessere, vielfältigere und kostengünstigere KI-Lösungen. Leider zeigt DeepSeek allerdings auch eine stark chinesisch geprägte Sichtweise auf vor allem politische Ereignisse und chinesische Systemgegner.

Die zentrale Erkenntnis: Wer heute noch denkt, dass nur wenige Tech-Giganten den KI-Markt dominieren werden, sollte seine Einschätzung überdenken. DeepSeek beweist, dass mit innovativen Ansätzen und effizientem Ressourceneinsatz auch neue Akteure die Spielregeln verändern können. Die KI-Revolution hat gerade erst begonnen, und DeepSeek könnte dabei eine entscheidende Rolle spielen.

Quellen:

https://www.mraiengineer.com/2025/01/deepseek-moe.html?m=1

https://en.wikipedia.org/wiki/DeepSeek_(chatbot)

https://www.reuters.com/technology/chinas-deepseek-sets-off-ai-market-rout-2025-01-27

esono.de: https://shorturl.at/Ih1HN

Klicke hier, um zum Artikel über Perplexity zu kommen.